https://sul21.com.br/wp-content/uploads/2023/04/redes-sociais-1-1080x679.jpg 956w" alt="A sociedade discute a regulamentação das redes e Tarcizio argumenta pela necessidade de que o tema do 'racismo algorítmico' entre na pauta. Foto: Pixabay/CC" class="single-img-full" style="box-sizing: border-box; border: 0px; max-width: 100%; vertical-align: middle; display: inline-block; width: 921.25px; border-radius: 5px;" loading="lazy" />

https://sul21.com.br/wp-content/uploads/2023/04/redes-sociais-1-1080x679.jpg 956w" alt="A sociedade discute a regulamentação das redes e Tarcizio argumenta pela necessidade de que o tema do 'racismo algorítmico' entre na pauta. Foto: Pixabay/CC" class="single-img-full" style="box-sizing: border-box; border: 0px; max-width: 100%; vertical-align: middle; display: inline-block; width: 921.25px; border-radius: 5px;" loading="lazy" />

Empresas de tecnologia digital utilizam algoritmos para diversas finalidades. São padrões e sequências automatizadas para resolver algum problema. Eles são responsáveis, por exemplo, pela distribuição de conteúdos específicos para cada pessoa em redes sociais. Também estão por trás de experimentos de inteligência artificial, onde “comandam” as estratégias do aprendizado de máquina. Contudo, são pessoas que os programam. Dito isso, a ciência agora se debruça sobre os problemas humanos transmitidos a esses algoritmos. Questões como racismo, machismo e classismo.

“Uso o termo ‘racismo algorítmico’ para explicar como tecnologias e imaginários sociotécnicos em um mundo moldado pelo privilégio branco fortalecem a ordenação racializada de conhecimentos, recursos, espaço e violência em detrimento de grupos não brancos”, resume o pesquisador Tarcízio Silva, da Fundação Oswaldo Cruz (Fiocruz), em artigo do Centro de Estudos Estratégicos da Fiocruz Antonio Ivo de Carvalho (CEE-Fiocruz).

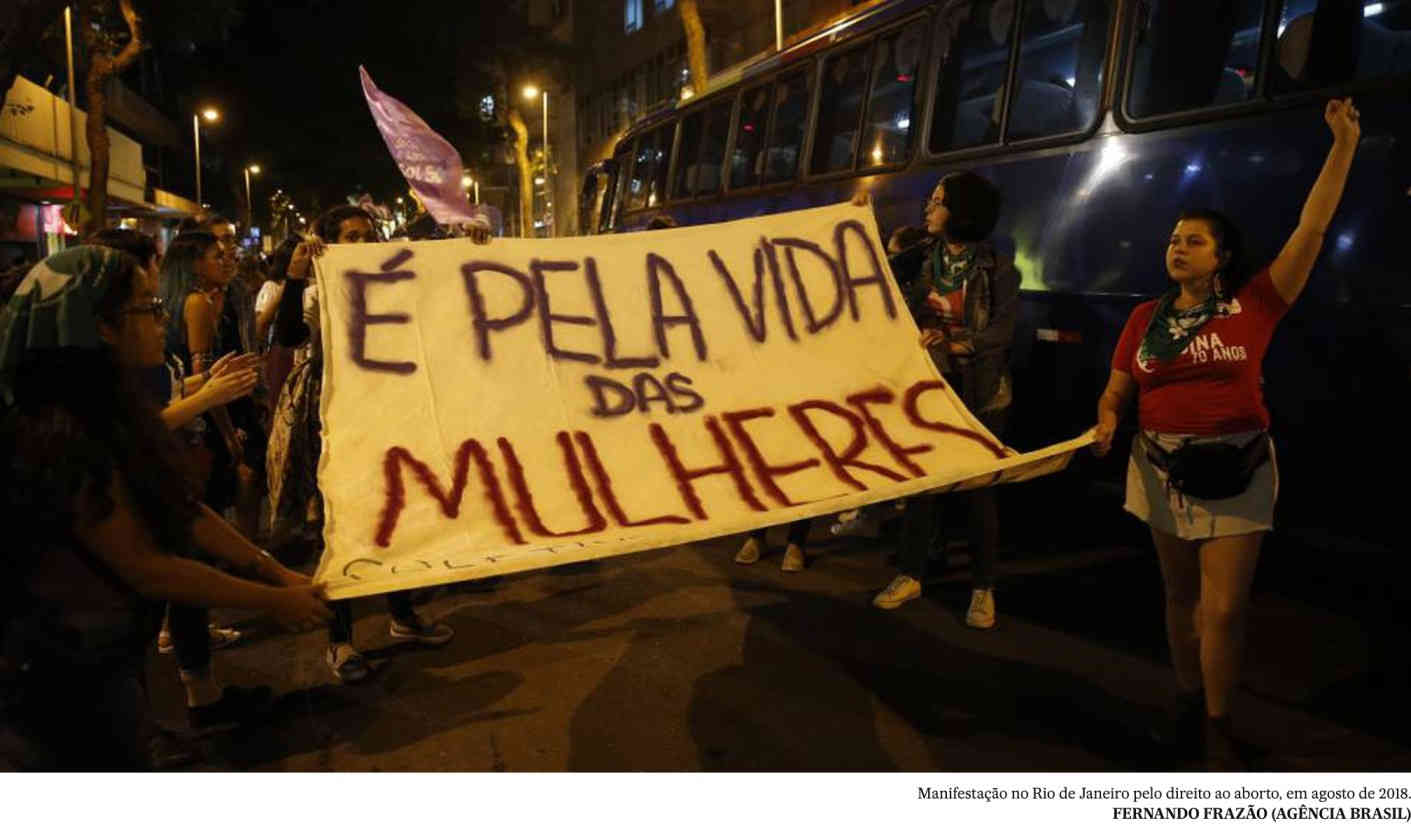

Então, enquanto a sociedade discute a regulamentação das redes, Tarcizio argumenta pela necessidade de que o tema do ‘racismo algorítmico’ entre na pauta. As iniciativas para entender e controlar as novas tecnologias, em especial as redes sociais e a Inteligência Artificial (IA), estão em evidência em todo o mundo. No Brasil, o governo Luiz Inácio Lula da Silva (PT) adotou uma agenda de debates sobre o combate à cultura do ódio nestes ambientes. Na última semana, inclusive, o Ministério da Justiça editou uma portaria para obrigar que as empresas retirem do ar conteúdos impróprios de incitação à violência.

Neste contexto, Tarcizio lembra que as decisões das redes, a distribuição de conteúdos, entre outras ações, não são isentas. “O principal problema na superfície é que sistemas algorítmicos podem transformar decisões e processos em caixas opacas inescrutáveis, isto é, tecnologias repletas de problemas são lançadas na sociedade e podem aprofundar discriminações, que vão de buscadores que representam negativamente pessoas negras até softwares de policiamento preditivo – uso de dados e análises para predizer o crime – que fortalecem a seletividade penal”, afirma

Por isso, o pesquisador chama a atenção para o método de elaboração destes mecanismos. Em suma, ele faz um libelo pela transparência. “O desenvolvimento de tecnologias algorítmicas se alimenta do histórico social para oferecer uma pretensa inteligência artificial. Mas essa ‘desinteligência’ artificial, que atualiza opressões como o racismo estrutural, é vendida como neutra”, afirma.

É por essas e outras que Tarcizio enxerga a questão do racismo algorítmo como uma consequência lógica do racismo estrutural. Mais do que isso, uma “atualização”, sua “ponta de lança na era da datificação da sociedade”. “A manutenção do racismo como sistema de produção de vantagens em prol de um grupo hegemônico, a branquitude, é profundamente dependente de uma epistemologia da ignorância para manutenção do poder. Em outras palavras, a branquitude mantém uma compreensão limitada da sociedade para que as estruturas de poder racializadas e generificadas não sejam questionadas”, argumenta.

Por fim, o cientista pensa ser indispensável o controle das redes e de outras novas tecnologias. “O controle social da tecnologia é um objetivo indispensável, se desejarmos futuros democráticos e benéficos para o mundo. O Brasil é um exemplo teórico de governança da internet multissetorial, com mecanismos de participação de setores como governo, empresas, sociedade civil e academia na discussão sobre políticas, regulação e caminhos da internet. Na prática, porém, o setor privado tem agido de forma consistente contra os interesses da população, em alguns momentos até promovendo desinformação sobre governança.”

372

372